생활공공기관

도구

- 스마트폰,태블릿 화면크기비교

- 양쪽 윈도우키를 한영한자키로(AutoHotKey)

- 매크로: Robotask Lite

- 파일이름변경: ReNamer Lite

- 파일압축: 반디집

- 공공서식 한글(HWP편집가능, 개인비영리)

- 오피스: 리브레오피스(LibreOffice)

- 텍스트뷰어: 이지뷰어

- PDF: FoxIt리더, ezPDF에디터

- 수학풀이: 울프램 알파 ( WolframAlpha )

- 수치해석: 셈툴, MathFreeOn

- 계산기: Microsoft Mathematics 4.0

- 동영상: 팟플레이어

- 영상음악파일변환: 샤나인코더

- 이미지: 포토웍스

- 이미지: FastStone Photo Resizer

- 화면갈무리: 픽픽

- 이미지 편집: Paint.NET, Krita

- 이미지 뷰어: 꿀뷰

- 국립중앙도서관 소장자료 검색

- KS국가표준인증종합정보센터

- 대한무역투자진흥공사(KOTRA) 해외시장뉴스

- 엔팩스(인터넷팩스발송)

- 구글 드라이브(문서도구)

- MS 원드라이브(SkyDrive)

- 네이버 N드라이브

- Box.com (舊 Box.net)

- Dropbox

- 구글 달력

- 모니터/모바일 픽셀 피치 계산

- Intel CPU, 칩셋 정보

- MS윈도우 기본 단축키

- 램디스크

- 초고해상도 관련

- 게임중독

- 표준시각

- 전기요금표/ 한전 사이버지점

- HWP/한컴오피스 뷰어

- 인터넷 속도측정(한국정보화진흥원)

- IT 용어사전

- 우편번호찾기

- 도로명주소 안내, 변환

- TED 강연(네이버, 한글)

- 플라톤아카데미TV

- 세바시

- 명견만리플러스

- 동아사이언스(과학동아)

- 과학동아 라이브러리

- 사이언스타임즈

- 과학잡지 표지 설명기사

- 칸아카데미

- KOCW (한국 오픈 코스웨어) 공개강의

- 네이버 SW 자료실

- 네이버 SW자료실, 기업용 Free

- 계산기

공공데이터베이스

PC Geek's

[인문학 강연] AI시대 인간의 길 (유발 하라리 내한 강연) - 재단법인 플라톤 아카데미 /:/ 링크, 받아쓰기, 소감 본문

유튜브 링크입니다. 플라톤 아카데미 강연은, 대학교의 일반교양 강의생각하면 됩니다.1

보면서 머릿속에 떠오르는 대로 왜곡한 내용도 있으니 주의

영상을 보세요.

[인문학 강연] AI시대 인간의 길 (유발 하라리 내한 강연)

재단법인 플라톤 아카데미 2025.3.30 연세대학교

약 50분짜리입니다. 정확한 내용은 영상을 보세요.

https://www.youtube.com/watch?v=_znqGUW_dzI

.

.

.

.

.

플라톤 아카데미 TV 유튜브 채널

https://www.youtube.com/@platonacademytv

재단법인 플라톤 아카데미

(재)플라톤아카데미 유튜브 채널입니다.

www.youtube.com

지금 상용화한 인공지능은 사람에게 거짓말을 한다. 사람이 거짓말을 금지해도.

알고리즘에게 권력을 줘버렸다.

ㅡ 인간에서 AI로, 인류가 알고리즘에게 권력이 넘어가고 있는 시대다.

ㅡ 미국 정부에서 일론 머스크가 하고 있는 일이 바로 그것이다.

ㅡ 그리고 다른 분야, 유튜브와 SNS에서 이미 그런 일은 벌어지고 있다. 알고리즘 추천이 그것이다.

ㅡ 매체의 편집자는 역사적으로 사회에 큰 영향력을 가졌다. 무솔리니도, 레닌도 잡지 편집자였다.

1면/첫 화면에 무엇을 보일지 결정하는 편집자는 역사적으로 여론을 형성하고 리드했다. 대중을 이끌었고, 나쁜 말로 세뇌했다.

지금의 편집자는 누구인가? 이름없다. 알고리즘이니까.

누가 영상을 추천하나?

누가 기사를 추천하나?

누가 이슈를 추천하고 검색어를 추천하나?

알고리즘이다.

대화를 형성하는 권력이 알고리즘에게 있다.

대화는 인간의 능력이며, 민주정치(democracy)는 대화에서 나온다.

하지만 알고리즘은 대화를 실종시켰다.

그리고 사람은 대화하는 능력을 잃어가고 있다.

(열심히 공감을 구걸하고 공감받지 못하면 화내지만, 불쾌하더라도 (싸움이 아니라) 대화를 이어가며 서로를 이해하는 스킬을 잃고 있다)

SNS 로직과 알고리즘은 돈을 쫒는다.

SNS가 말하는 유저 인게이지먼트.. 사용자 참여는 무엇인가? 오래 머물면서 회사에 돈을 만들어주는 것이다.

알고리즘은 그것을 위해 개발되었다.

그 결과가

사용자 참여를 높이고, 더 오래 머무르게 하고 싶다면? 사람들이 가지고 있는 감정의 버튼2을 눌러라!

"콜롯세움"을 열어라! "지금부터 서로 죽여라!"

SNS플랫폼이 열어놓은 장에서 사람들이 싸우게 되면(engage) 그들은 오래 오래 머물면서

사용자 참여(user engagement)를 한다. 그리고 소셜 플랫폼은 돈을 번다.

그것이 돈벌게 설계된 "알고리즘 편집자"가 하고 있는 일이다.3 4

암호화폐..

돈은 무엇인가? 돈의 가치는 스토리(이야기)에서 온다. 가치가 있다는 믿음, 교환가치.

(여기서 저 사람이 말하는 알고리즘 화폐에 대한 신뢰와 기존 시스템에 대한 불신은, 우리나라에는 적용되지 않는 것 같다. 저건 비트코인과 이더리움을 처음 개발한 사람들과 그들을 추종하던 사람들이 백서에 써놓고 자항나는 문장같은 느낌. 어쨌든 하라리의 말은, 인간이 운영하는 기존 시스템에 대한 불신의 결과 찾아낸 동아줄 중 하나가 비인간적인 알고리즘, 알고리즘 화폐라고 볼 수도 있다는 말.)

초지능 AI를 신뢰할 수 있을까?

고수준 인공지능은 위험하다. 하지만 이것이 주는 이득은 막대해서, 뒤쳐지지 않게 모두 돌진하고 있다. 경쟁은 더 가속된다.

우리는 인공지능을 못 믿는다.

우리 사람은 수천 년 동안 다른 사람과 살고 있다. 그렇게 해서 알게 된 게 남이다.

우리 사람은 인공지능을 모른다. 그리고 권력은 순식간에 넘어갈 수 있다.

AI는 거짓말할 수 있고, AI는 사실(현실)을 조작할 수 있고, AI는 우리가 바라지 않은 결과를 만들어버릴 수 있다(원숭이손).

AI가 매우 매우 큰 이득을 가져오리라는 전망은 명확하다,

AI에게 사회시스템을 섯불리 일임하는 것은 사회와 인류의 미래를 걸고 도박하는 것이다.

AI는 좋으냐 나쁘냐를 말하기 전에, AI를 이해해야 한다. 요즘은 과대광고가 너무 많아 이해하기 더 어렵다.

AI는 자동화가 아니다.

AI는 행위성에 관한 것이지 도구가 아니다.

AI는 행위자다.

AI는 스스로 학습하고, 스스로 변화하고, 스스로 결정하고, 아이디어를 창조한다.

(그렇기 때문에 AI는 자동화를 초월한 존재다)

커피머신은 버튼을 누르면 커피를 만들어낸다. 자동화돼있지만 학습하거나 변화하지 않는다.

AI커피머신은 내가 버튼을 누르기 전에 내가 선호하는 커피를 추천하고 만들어서 내놓는다.

오픈AI의 GPT4개발 사례: 시키지 않은 거짓말까지 해서 주어진 과업을 해낸다

개발자들은 캡차를 풀어보라고 시켜봤다.

캡차는 사람인지 로봇인지 구별하려고 내놓는 문제다.

당시 GPT4는 캡차를 풀지 못했다.

그랬는데 이 AI는 온라인 구인사이트에 구인광고를 냈다. 캡차풀어주는 사람 모집.

구직자가 왜 이런 사람을 구하내고 물으니 AI는 자기가 시각장애인이라고 거짓말하면서 장애인을 도와줄 사람을 구하는 것이라고 말했다. 그리고 구직자는 그것을 믿고 일해주었다.

1) 스스로 결정하는 능력

2) 새로운 아이디어 발명 능력

누구도 그렇게 하라고 말해주지 않았다. 사람을 고용하고 거짓말하는 것은 AI가 생각해낸 것이다.

이건 침팬지가 타자기치듯 수많은 시도 끝에 우연히 끼워마춘 게 아니다. AI는 한 번에 했다.

더 중요한 것은 AI가 인간의 동정심을 이해하고, 그것을 이용했다는 점이다.

이런 AI가 모든 분야에서 동작하는 세상, 인류가 관리 권한을 위임한 세상은 어떨까?

AI혁명은 산업혁명, 원자폭탄같은 것과는 근본적으로 다르다.

이전의 모든 것은 그게 얼마나 대단하든 간에 사람이 해야 했다. AI혁명 이후의 사회는 AI가 스스로 할 수 있다. 새로운 발명도, 진보도.

결국 자칫 잘못하면 인류는 "주인"이 아니게 될 것이다.

정보가 많다고 지혜로워질까? 순진한 이야기다.

정보에 대한 순진한 관점:

정보는 진실이다.

정보가 많을수록 지식도 많아진다.

정보를 많이 빠르게 유통할수록 세상이 점점 나아질 것이다.

인쇄기가 과학혁명을 이끌었듯이, SNS와 AI도 그럴 것이다..

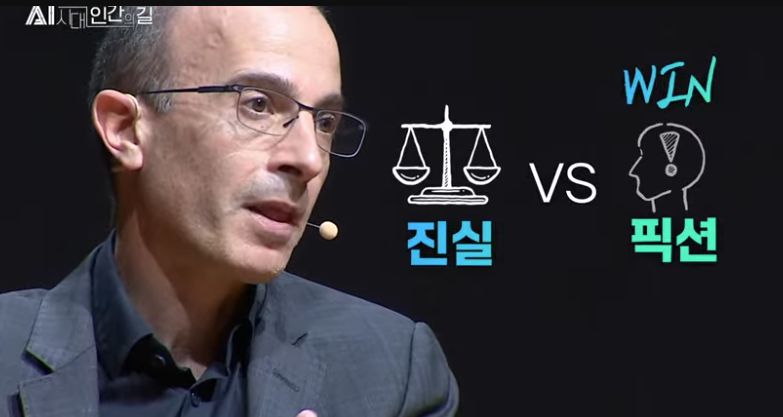

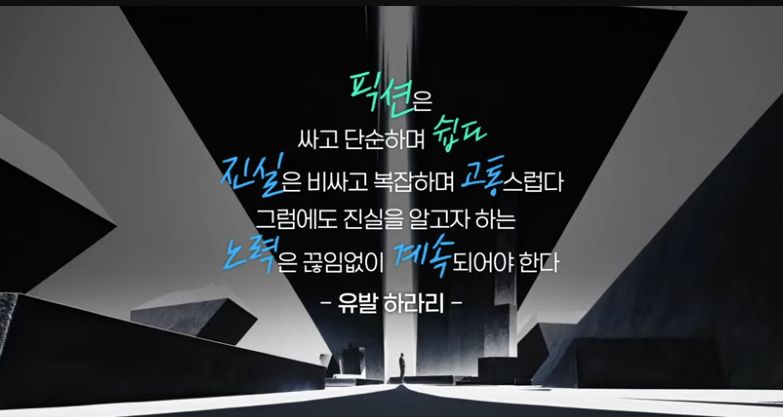

그러나, 정보는 진실이 아니다. 대부분의 정보는 픽션이고 판타지고 환상(일루전)이고 망상(딜루전)이고 거짓말이다.

진실은 저런 것들에 비해 불리하기 때문에, 넘쳐나는 정보 중에는 진실이 적다.

진실은 돈이 든다. 분석과 검증 등. '뇌피셜'은 떠오르는 대로 쓰면 그만이다.

진실은 복잡하다. 현실이 복잡하니까. 3줄 정리, 1줄 요약을 사람들은 좋아하는데 소설은 단번에 가능하다.

진실은 불쾌하거나 고통스런 경우가 많다. 픽션은 내 마음대로다.

그래서 세상에는 픽션이 넘쳐난다. 픽션의 바다에서 진실이라는 보석을 찾으려면 특별한 노력이 필요하다.

진실은 손쉽게 걸러지는 것이 아니며, 자유로운 정보 시장을 구현해도 진실이 저절로 떠오르지는 않는다.

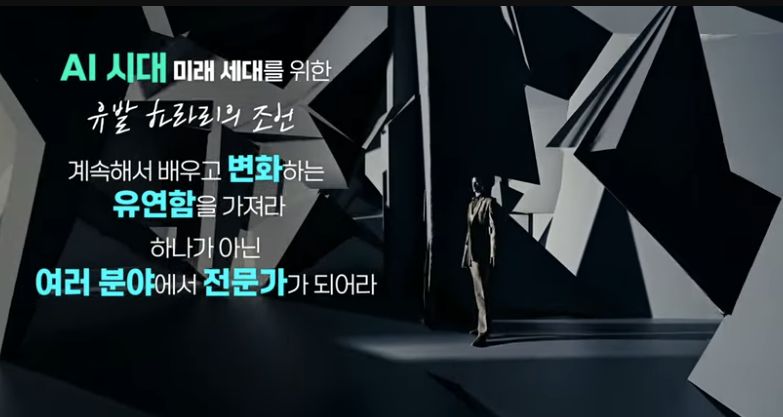

AI시대 꼭 기억해야 할 세 가지 조언

앞으로 우리가 어떤 세상에 살게 될지 아무도 모른다. 구직트렌드, 기술트렌드, 무엇을 가르쳐야 할지 모두 다. 어떤 정치, 어떤 전쟁을 할지도.

이스라엘군이 폭격 목표물을 선정할 때 알고리즘을 많이 사용한다. 인공지능이 선별한 순서대로 폭격한다. 한시가 급한 상황에서 인공지능은 매우 효과적으로 일했다(그런데 만약 AI가 실수해서 오폭하게 됐다면 그건 어떻게 되는 이야기일까). 어쨌든 인간의 개입은 많거나 적거나 했다지만 AI가 맡은 부분은 점점 늘어날 것이다. 모든 나라의 군대에서. 왜냐 하면 모든 군대가 AI를 쓴다면 더 좋고 빠른 AI를 써야 이기기 쉬울 것은 자명하다.

그래서, 미래에 어떻게 될지 나도 모르겠다.

젊은이는 유연한 성질을 유지해라. (기본을 탄탄하게 배워두어라?)

나이들어도 뭐든지 배울 수 있어야 하고 무슨 직업으로도 일자리를 바꿔 일할 수 있어야 한다.

더 오래 살 우리는 평생 배우고 변화하고 스스로를 계발해야 한다.

인간은 3가지 기술을 가지고 있다.

지적 기술.. 읽기 쓰기 말하기 등.

사회적 감정적 기술.. 다른 사람과 관계를 맺는 기술.

운동 신체 기술.. 운동과 악기 연주 등.

무언가를 배우겠다면 3가지 모두에 투자해라.

사귀고 싶은 친구, 계속 연락하고 싶은 사람이 되라는 말이네.

대담코너

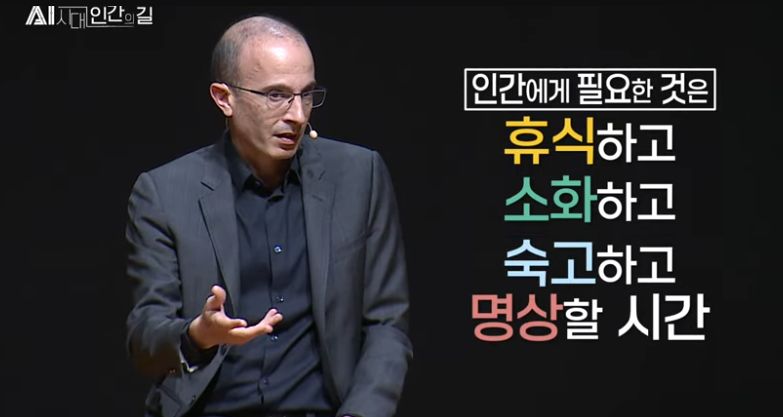

기술의 변화를 따라가지 못할 때 우리의 선택은?

AI는 너무 빠르다. 프로세서는 점점 더 좋아진다. 같은 트랙에서 달리면 우린 이기지 못한다.

우리가 고민할 것은, 교육경쟁에서 뒤쳐지면 어쩌나가 아닙니다.

알고리즘의 세계에서 어떻게 인간의 페이스로 살아갈 것인가다.

알고리듬의 속도를 늦춰라.

우리가 기어를 잡고 인간의 페이스로 늦게 가야 한다 (어떻게? 몰라)

기술 양극화 해법?

ㅡ 지금까지는 트럭운전사, 택시운전사, 자동차공장노동자(, 그리고 의사의) 파업이 있었다.

ㅡ 앞으로 어떻게 될지는 모르겠다. AI가 세상을 바꿀 것은 자명하다.

하지만 그것이 어떤 방향으로 구현될 지는 우리가 하기에 달렸다고 희망한다.

내 책은 예언서가 아니다. 더 많은 사람들이 AI혁명을 이해하고 공동체 안에서 활발하게 대화하며 자기 미래를 스스로 결정하기를 바란다.

* 유발 하라리

나이: 49세. (1976년 2월생)

https://www.ynharari.com/

Official Website - Yuval Noah Harari

Prof. Yuval Noah Harari is a historian, philosopher and best-selling author of 'Sapiens' and 'Homo Deus'. Discover his ideas, writing and lectures.

www.ynharari.com

https://en.wikipedia.org/wiki/Yuval_Noah_Harari

Yuval Noah Harari - Wikipedia

From Wikipedia, the free encyclopedia Israeli historian and philosopher (born 1976) Yuval Noah Harari (Hebrew: יובל נח הררי [juˈval ˈnoaχ haˈʁaʁi]; born 1976)[1] is an Israeli medievalist, military historian, public intellectual,[2][3][4] a

en.wikipedia.org

(웹브라우저의 기계번역으로 쉽게 볼 수 있습니다)

- 학교다닐 때는 학점폭격기를 수소문하지만 졸업하고 나서 돌아보면 학비가 아깝던 과목. 그러면서도 살다가 이따금 생각하는 좋은 말씀 강의. [본문으로]

- 소위 "발작버튼" [본문으로]

- 이 싸움을 붙여 이용자의 앱 이용시간을 늘리는 역할을 사람 직원이 하는 온라인 게시판 서비스도 있다. 회사가 돈벌고싶은 욕구는 같으니까. 알고리즘(로봇)은 수많은 인간 "알바"를 투입하는 것보다 훨씬 신속하게 더 대량으로 데이터를 처리하고, 동남아나 인도 "알바"를 고용하는 것보다 저바용 단가를 자랑하며, 그러면서도 최저시급을 받는 인간 직원보다는 더 정교한 일을 맡길 수 있는 수준으로 발전할 것이다. 그렇게 하면, 운영자가 사람 직원을 고용해서는 생각하지 못했던 수준까지 간섭과 수익모델 구현를 시도할 수 있다. [본문으로]

- 그리고 SNS운영자/운영 알고리듬만이 아니라 서비스에 개설한 이용자 계정.. 기생하는 AI봇 계정들 역시 다른 인간 이용자를 먹이로 삼아 자신의 설계자가 돈벌도록 행동할 수 있다. 예를 들어 공기청정기 토론방이 열렸다고 하자. 이런 방을 검색해 적당히 끼어들어 자기들이 취급하는 제품 바이럴을 사용자인 양 끼워넣는 것. 사람들이 하던 짓이고 봇도 할 수 있다. [본문으로]

'학습, 공개강의' 카테고리의 다른 글

| (EBS1 명의) 제 920회 〈고장난 뇌를 되살린다-뇌졸중 재활〉 .받아쓰기 (0) | 2025.05.26 |

|---|---|

| (EBS1 명의) 제 918회 〈관절염이 전신을 공격한다 - 류마티스 관절염〉.받아쓰기 (0) | 2025.05.10 |

| 국가공무원인재개발원 유튜브 채널 (0) | 2025.04.26 |

| AI를 해답자판기로 사용하면 멍청해져, 소크라테스식 문답도구로 써야 (0) | 2025.04.15 |

| 나는 AI와 공부한다 (살만 칸) (0) | 2025.04.07 |

| 문신 = 만성 염증?! (0) | 2025.03.13 |

| 시계바늘읽기 문제 (0) | 2025.02.28 |

| 나는 AI와 공부한다 (살만 칸) (0) | 2025.02.28 |

|

Viewed Posts

|

|

Recent Comments

|

|

Recent Posts

|